Tekoälynatiivien järjestelmien testaus ja laadunvarmistus

Erikoisosaamista järjestelmiin, jotka eivät käyttäydy kuten perinteinen ohjelmisto

Alan johtavana laadunvarmistuksen toimijana autamme rakentamaan luottamusta tekoälynatiiveihin järjestelmiin – niihin, joissa käyttäytyminen ei ole täysin ennustettavaa, tulokset eivät aina ole suoraan verifioitavissa.

Tarvitsetko yksittäistä asiantuntijaa täsmälliseen tarpeeseen vai kokonaisvaltaista laadunvarmistusratkaisua? Me autamme molemmissa. Parannetaan laatua yhdessä, ota yhteyttä!

Miksi?

Perinteisessä ohjelmistotestauksessa sama syöte tuottaa aina saman tuloksen. Tekoälynatiiveissa järjestelmissä näin ei aina ole: malli voi tuottaa erilaisia vastauksia eri konteksteissa, käyttäytyä odottamattomasti reunatapauksissa tai heiketä huomaamattomasti ajan myötä, jos sen toimintaympäristö muuttuu.

Tämä muuttaa laadunvarmistuksen luonnetta perustavanlaatuisesti. Kyse ei ole enää pelkästään oikeellisuuden vahvistamisesta vaan luottamuksen rakentamisesta järjestelmään, jonka käyttäytymistä ei voi täysin selittää. Ilman selkeitä, mitattavia arviointikriteerejä aukot laadussa kertyvät näkymättömästi ja paljastuvat liian myöhään, kun asiakas törmää niihin.

Hyvin testattu tekoälyjärjestelmä on sellainen, johon voi luottaa; niin kehittäjät, liiketoiminta kuin loppukäyttäjätkin. Käytännössä tämä tarkoittaa: järjestelmä tuottaa johdonmukaisia ja tarkoituksenmukaisia tuloksia, sen suorituskyky pysyy hallinnassa myös tuotannossa, ja keskeisimmät eettiset ja tekniset riskit, kuten hallusinaatiot, syrjivät harhat sekä epäjohdonmukainen käyttäytyminen, on tunnistettu ja hallittu ennen kuin ne aiheuttavat vahinkoa tai murentavat luottamuksen.

Tämä ei ole enää vain suositus, vaan vaatimus: EU:n tekoälyasetus (AI Act) asettaa uuden standardin tekoälyjärjestelmien dokumentoinnille, läpinäkyvyydelle ja riskienhallinnalle. Kattava ja todennettavissa oleva laadunvarmistus onkin jatkossa paitsi kilpailuetu, myös välttämätön perusta säädöstenmukaisuudelle.

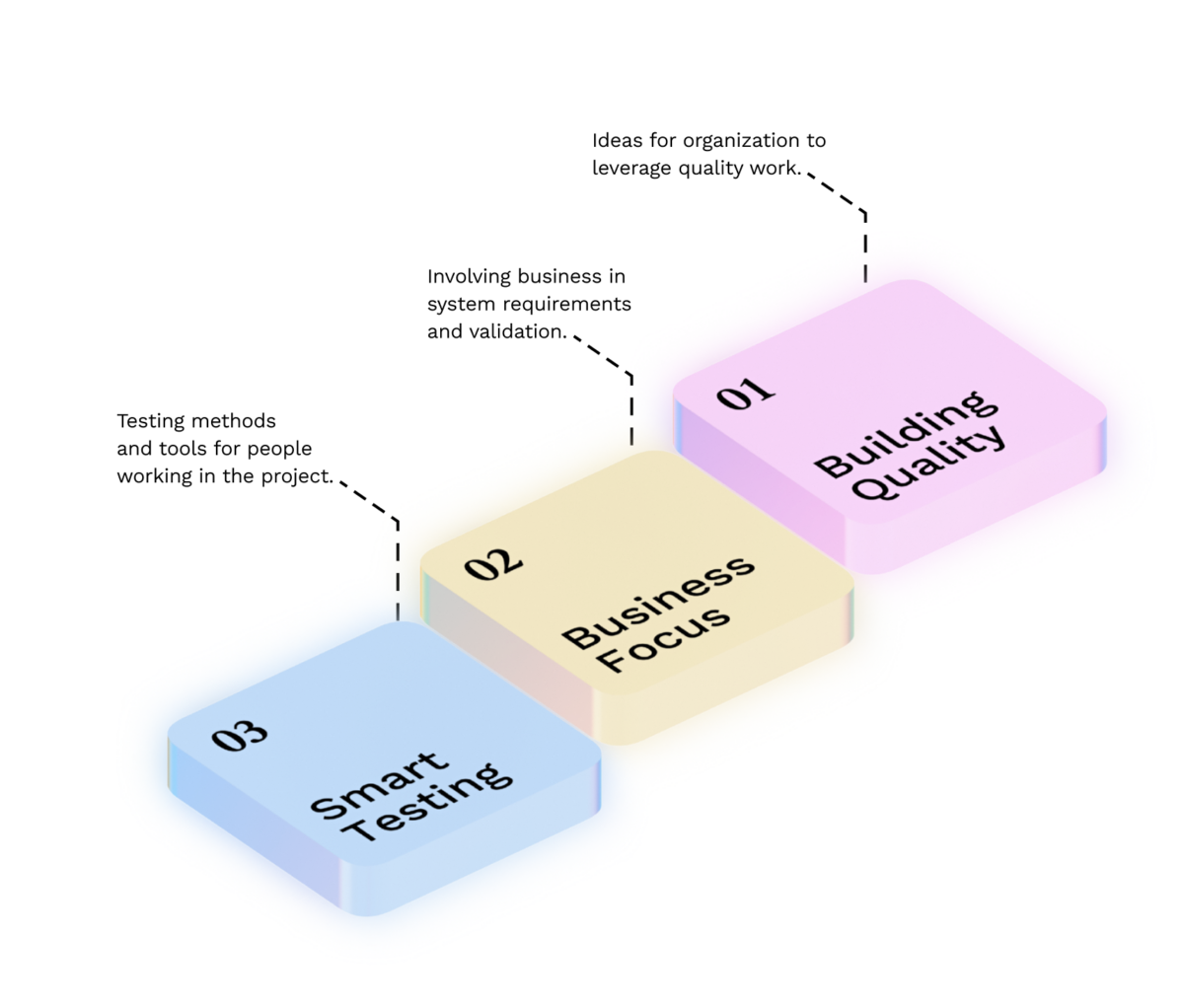

Kaikki työmme perustuu VALA Quality Modeliin. Tekoälynatiivien järjestelmien laadunvarmistus ulottuu mallin kaikille tasoille: se alkaa laadun rakentamisesta – selkeiden arviointikriteerien ja testattavuuden varmistamisesta – kattaa liiketoimintatavoitteiden linjaamisen ja päättyy käytännön testaukseen sekä jatkuvaan seurantaan. Tutustu VALA Quality Modeliin tarkemmin täältä.

Haluatko tietää, miten voisimme auttaa varmistamaan tekoälyjärjestelmäsi luotettavuuden?

Tekoäly ei validoi itseään

Tekoäly tuottaa uskottavia tuloksia. Laadunvarmistus etsii sitä, mikä on väärässä, puuttuu tai on ymmärretty väärin. Nämä ovat vastakkaisia näkökulmia.

Pyytämällä tekoälyä arvioimaan omaa tuotostaan ei poisteta järjestelmän epävarmuustekijöitä, vaan ne ainoastaan peitetään näennäisen vakuuttavuuden alle. Tekoälynatiivien järjestelmien laadunvarmistus vaatii ihmistä: jonkun, joka määrittelee mitattavat laatutavoitteet, rakentaa arviointikehyksen, suunnittelee testidatan ja tulkitsee tulokset kriittisesti.

Lue lisää näkemyksistämme AI in QA white paperistamme.

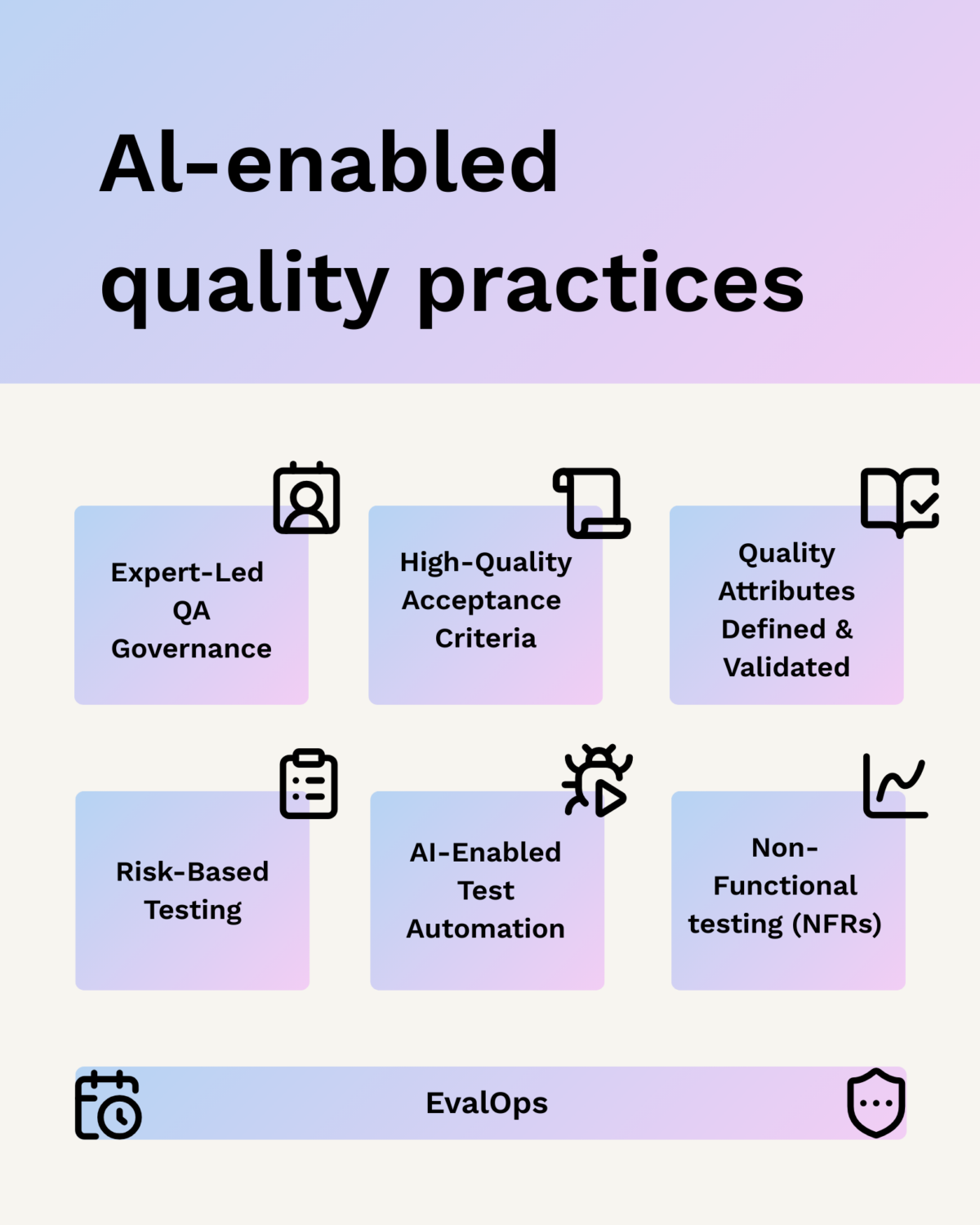

AI-aikakaudella QA:n merkitys korostuu entisestään: selkeät hyväksymiskriteerit ohjaavat nyt ihmisten lisäksi tekoälyagentteja. Laatuvaatimukset, kuten tietoturva ja suorituskyky, on määriteltävä heti alussa, jotta ne ohjaavat tekoälyn tuottamia ratkaisuja oikeaan suuntaan. EvalOps täydentää kokonaisuuden tuomalla laadunvarmistuksen jatkuvaksi palauteloopiksi, joka mahdollistaa tekoälymallien käytöksen mittaamisen ja parantamisen kehityksen jokaisessa vaiheessa.

Tekoälynatiivien järjestelmien laadunvarmistuspalvelumme

Miten autamme käytännössä?

VALAn asiantuntijat tuovat tekoälynatiivien järjestelmien testaukseen saman laadunvarmistuksen perustan kuin kaikkeen muuhunkin, täydennettynä tekoälyjärjestelmien erityispiirteiden osaamisella.

Rakennamme arviointikehyksiä, joissa tekoälyn tuotosten laatu on mitattavaa eikä vain arvioijan tuntumaan perustuvaa. Suunnittelemme testidatastrategian, joka kattaa todelliset käyttötapaukset, reunatapaukset ja haastavat syötteet – koska geneerinen testidata ei riitä, kun järjestelmän käyttäytyminen riippuu kontekstista. Kehitämme menetelmiä ei-deterministisen käyttäytymisen testaamiseen silloin, kun perinteiset expected/actual-vertailut eivät yksin riitä.

Autamme myös varmistamaan, että laadunvarmistus ei pääty julkaisuun: tekoälymalli voi heiketä tuotannossa ajan myötä, jos sen toimintaympäristö muuttuu, joten jatkuva seuranta on olennainen osa palveluamme. Tarvittaessa tuemme myös EU:n tekoälyasetuksen vaatimuksiin vastaamisessa dokumentoinnin ja testauksen osalta.

Miksi VALA

Olemme yksi Suomen suurimmista ohjelmistolaadun toimijoista, ja vuoden 2025 Great Place to Work -voittajana houkuttelemme ja pidämme alamme parhaat asiantuntijat. Tämä tarkoittaa, että asiakkaamme saavat asiantuntijoita, jotka todella tietävät mitä tekevät.

Tekoälyjärjestelmien testaus on uusi erikoisala, mutta se rakentuu samoille perustoille kuin kaikki muu laadukas testaustyö: selkeät tavoitteet, jäljitettävät testit ja riskipohjainen priorisointi. Yli 18 vuoden kokemus on opettanut meille, mikä näissä perustoissa on keskeisintä – ja miten niitä sovelletaan uuteen kontekstiin. Asiantuntijayhteisömme jakaa jatkuvasti tietoa tekoälyjärjestelmien testauksesta, joten asiakkaamme hyötyvät uusimmista ja parhaimmista käytännöistä.

Teknologiat ja Työkalut

Olemme teknologiariippumattomia; sovellamme työkaluja ja menetelmiä joustavasti asiakkaan tarpeen sekä ekosysteemin mukaan

Testauksen hallinta: Saumaton osa tiimin arkea (Azure DevOps, Jira, Xray).

Tekoälyn validointi: Mallien suorituskyky ja luotettavuus (esim. Ragas, LangSmith, Promptfoo).

Testiautomaatio: Modernit ja vakiintuneet ratkaisut, kuten Playwright, Robot Framework ja Python-pohjaiset työkalut.

Jatkuva seuranta: Toimivuuden varmistaminen julkaisun jälkeen (esim. Dynatrace ja räätälöity valvonta).

Haluatko tietää enemmän tekoälyn vakutuksesta ohjelmistotestaukseen?

Tekoälynatiivien järjestelmien testauksen osa-alueet

LLM- ja generatiivisen tekoälyn evaluointi

Suurten kielimallien toiminnan arviointi vaatii erityisiä evaluointikehyksiä. Sen sijaan, että tarkistettaisiin yhtä oikeaa vastausta, arvioidaan tuotosten johdonmukaisuutta, tarkoituksenmukaisuutta ja turvallisuutta – usein useissa rinnakkaisissa ajoissa ja eri syötevariaatioilla.

RAG-järjestelmien testaus

Retrieval-Augmented Generation -järjestelmissä tietohaku ja kielimalli toimivat yhdessä. Testaus kattaa sekä haun laadun – löytyykö oikea tieto oikeaan aikaan – että mallin kyvyn hyödyntää haettua tietoa oikein ilman hallusinaatioita tai kontekstin väärinymmärtämistä.

Tekoälyintegraatioiden testaus

Kun tekoälykomponentti on osa laajempaa järjestelmää, integraatiotestaus varmistaa, että osat toimivat yhteen odotetusti – myös silloin, kun tekoälyn tuotos on luonteeltaan vaihteleva.

Ei-deterministisen käyttäytymisen testaus

Perinteiset expected/actual-vertailut eivät yksin riitä, kun sama syöte voi tuottaa eri tuloksia eri ajokerralla. Kehitämme menetelmiä, joilla arvioidaan tuotosten laatu tilastollisesti ja erotetaan hyväksyttävä vaihtelu haitallisesta.

Bias- ja oikeudenmukaisuustestaus

Varmistamme, että järjestelmä toimii tasapuolisesti eri käyttäjäryhmille, konteksteille ja syötetyypeille – ja että mahdolliset harhat tunnistetaan ennen kuin ne päätyvät tuotantoon.

Jatkuva seuranta ja drift-tunnistus

Tekoälymalli voi heiketä ajan myötä, jos sen toimintaympäristö tai taustadata muuttuu. Jatkuva seuranta ja automaattiset hälytykset varmistavat, että laatu pysyy hallinnassa myös julkaisun jälkeen.

Kysy lisätietoja!